新闻中心

News Center

数据中心液冷的痛点和挑战

目录

1、液冷的强输入

2、液冷的标准化

3、IDC如何兼容风冷和液冷

4、可预见的未来设计

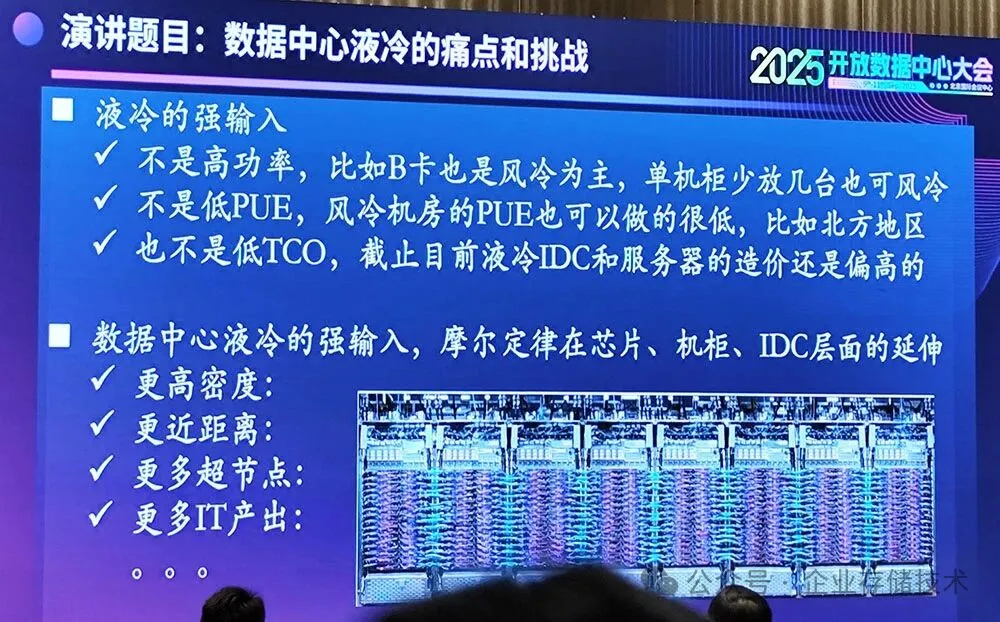

PART 01液冷的强输入

(澄清常见误区)

- 不是高功率,比如B卡也是风冷为主,单机柜少放几台也可风冷

- 不是低PUE,风冷机房的PUE也可以做的很低,比如北方地区

- 也不是低TCO,截止目前液冷IDC和服务器的造价还是偏高的

数据中心液冷的强输入,摩尔定律在芯片、机柜、IDC层面的延伸

- 更高密度:

- 更近距离:

- 更多超节点:

- 更多IT产出:

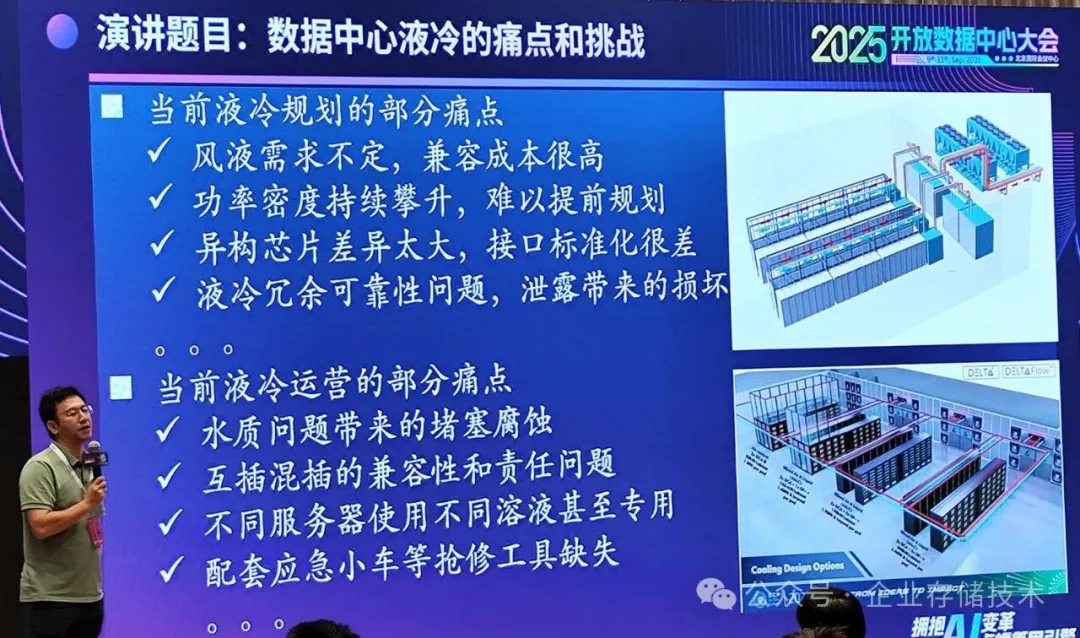

当前液冷规划的部分痛点

·风液需求不定,兼容成本很高:客户对采用风冷还是液冷的需求不明确,导致基础设施需同时兼容两种方案,造价高昂。

·功率密度持续攀升,难以提前规划:芯片功耗增长过快,导致机房功率密度规划难以跟上技术迭代速度,基础设施面临刚建成就可能落后的风险。

·异构芯片差异太大,接口标准化很差:不同厂商(如CPU、GPU、AI加速卡)的液冷接口设计不一,缺乏统一标准,增加冷板设计和机房部署的复杂性。

·液冷冗余可靠性问题,泄漏带来的损坏:担心冷板、快速接头等部件泄漏冷却液,导致服务器硬件损坏和业务中断,对冗余设计和可靠性要求极高。

当前液冷运营的部分痛点

·水质问题带来的堵塞腐蚀:冷却液水质管理不当会导致微生物滋生、结垢或腐蚀,堵塞精密冷板流道,影响散热效率甚至损坏设备。

·互插混插的兼容性和责任问题:不同品牌、型号的服务器液冷接口可能存在细微差异,混插部署时容易发生泄漏,出现故障后责任难以界定。

·不同服务器使用不同溶液甚至专用:各服务器厂商可能推荐或要求使用特定品牌、配方的冷却液,给数据中心统一采购、管理和维护带来巨大挑战。

·配套应急小车等抢修工具缺失:行业缺乏标准化的应急处理设备(如泄漏收集、快速抢修工具),一旦发生故障,恢复流程复杂、效率低下。

PART 02 液冷的标准化

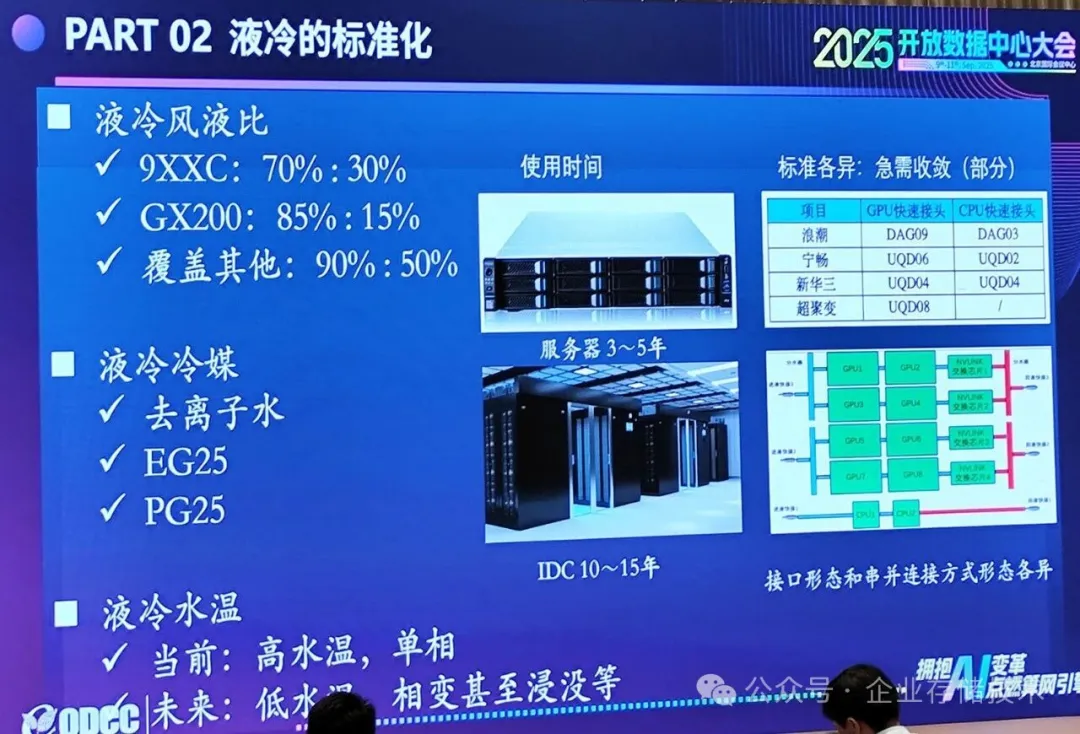

液冷风液比(不同服务器的液冷占比)

- 9XXC:70% : 30%

- GX200:85% : 15%

- 覆盖其他:90% : 50%

液冷冷媒(冷却液类型)

- 去离子水

- EG25

- PG25

液冷水温

- 当前:高水温,单相

- 未来:低水温,相变甚至浸没等

使用时间

- 服务器寿命:3~5年

- IDC(数据中心)寿命:10~15年

标准各异:急需收敛(部分)

项目 | GPU快速接头 | CPU快速接头 |

浪潮 (Inspur) | DAG09 | DAG03 |

宁畅 (Nettrix) | UQD06 | UQD02 |

新华三 (H3C) | UQD04 | UQD04 |

超聚变 (FusionServer) | UQD08 | / |

接口形态和串并连接方式形态各异

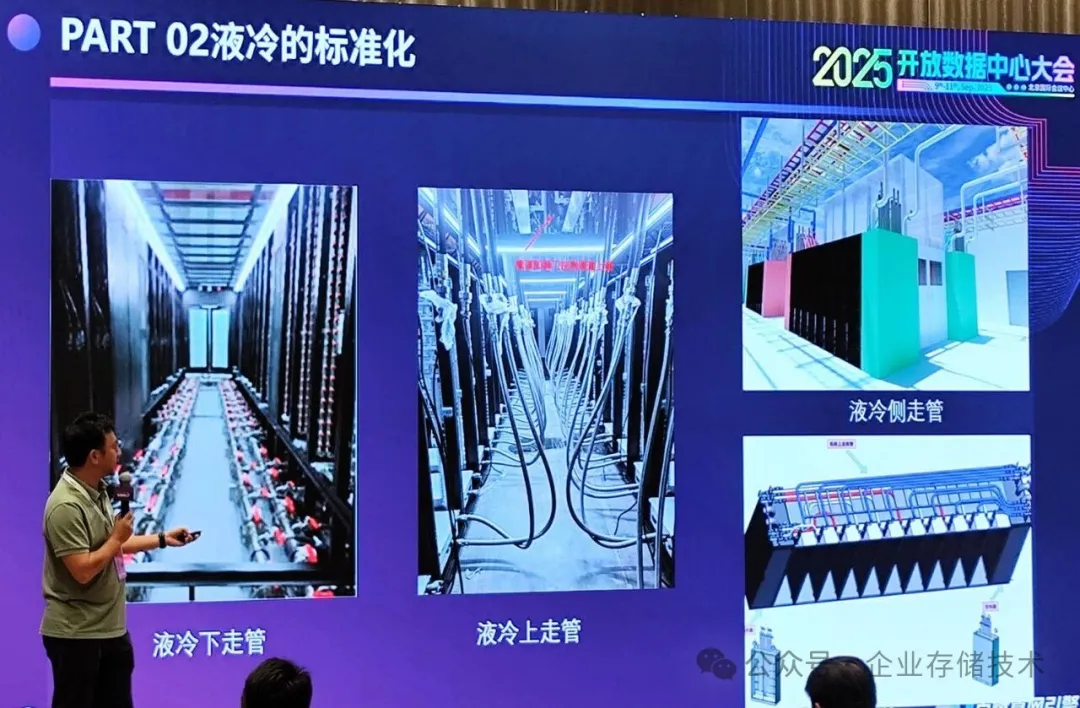

比较液冷下走管、上走管和侧走管 三种布局。

PART 03 如何兼容风冷和液冷

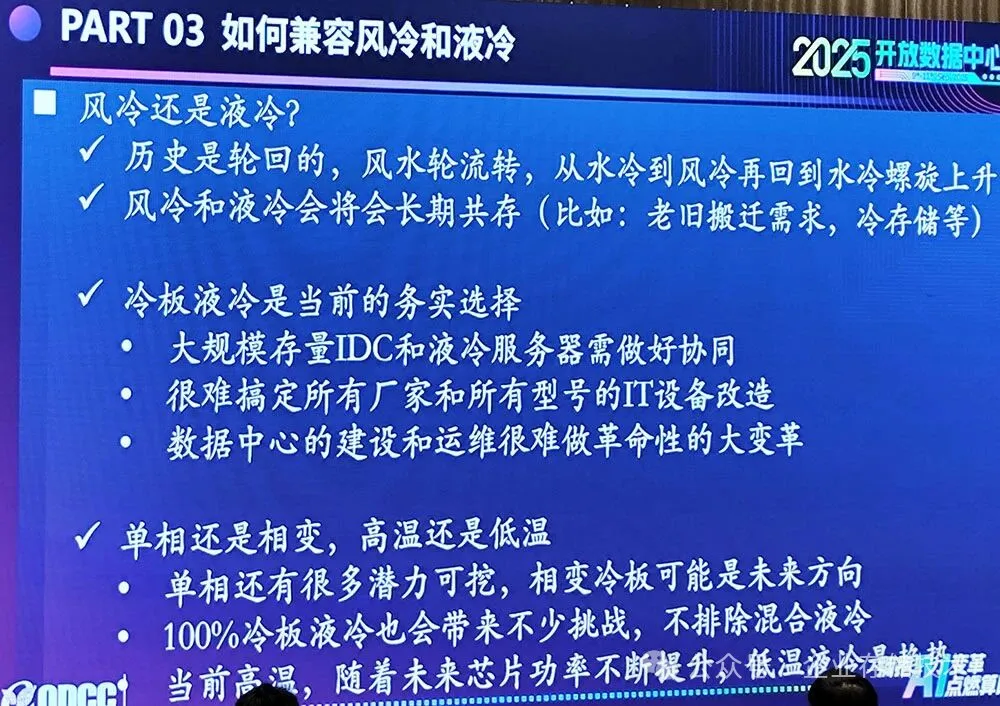

风冷还是液冷?

·历史是轮回的,风水轮流转,从水冷到风冷再回到水冷是螺旋式上升。

·风冷和液冷将会长期共存(例如:老旧设备搬迁需求、冷存储等场景)。

·冷板液冷是当前的务实选择。

- 大规模存量IDC和液冷服务器需做好协同。

- 很难搞定所有厂家和所有型号的IT设备改造。

- 数据中心的建设和运维很难做革命性的大变革。

·单相还是相变,高温还是低温

- 单相还有很多潜力可挖,相变冷板可能是未来方向。

- 100%冷板液冷也会带来不少挑战,不排除混合液冷。

- 当前高温,随着未来芯片功率不断提升,低温液冷是趋势。

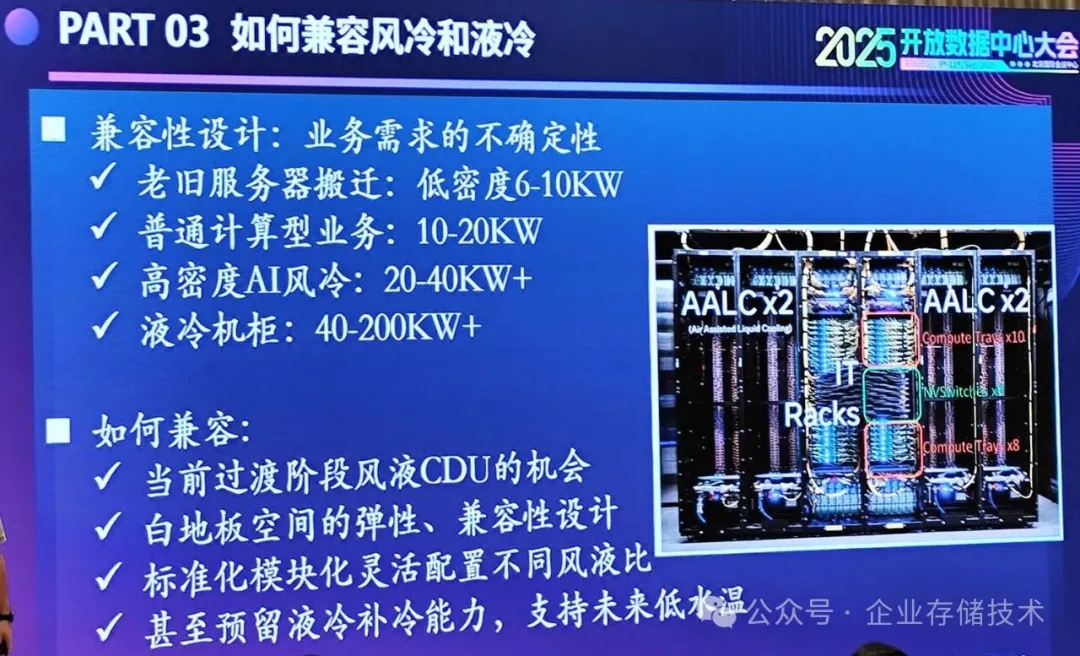

兼容性设计:业务需求的不确定性

·老旧服务器搬迁:低密度,功率范围6-10KW

·普通计算型业务:功率范围10-20KW

·高密度AI风冷:功率范围20-40KW+

·液冷机柜:功率范围40-200KW+

如何兼容

·当前过渡阶段风液CDU的机会

·白地板空间的弹性、兼容性设计

·标准化模块化灵活配置不同风液比

·甚至预留液冷补冷能力,支持未来低水温

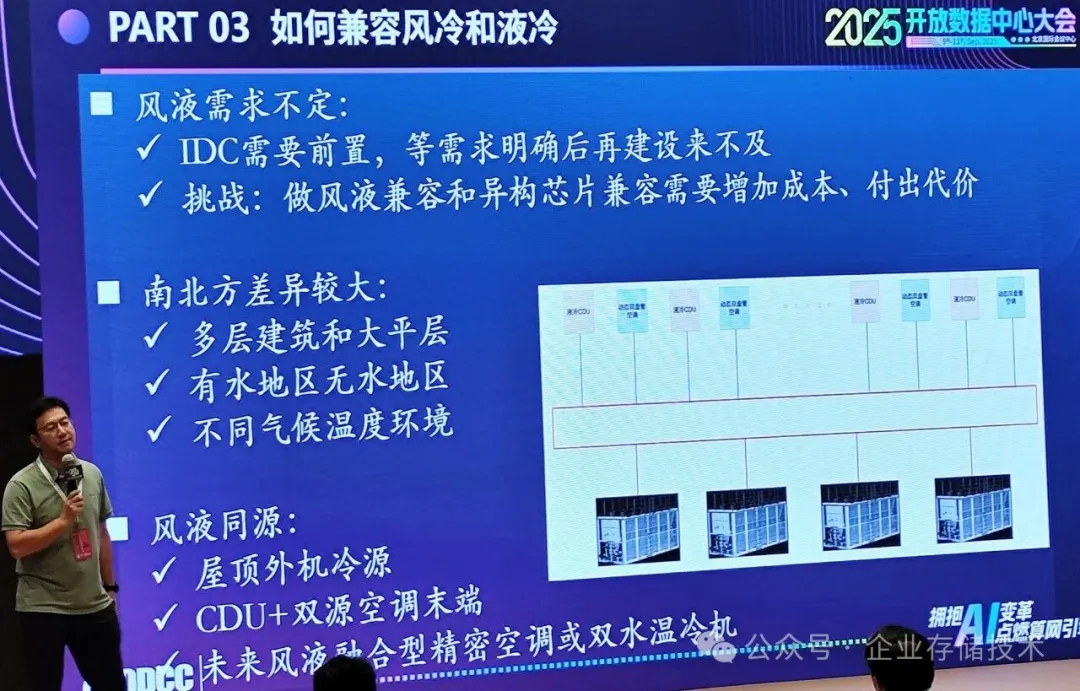

风液需求不定:

✓ IDC 需要前置,等需求明确后再建设来不及

✓挑战:做风液兼容和异构芯片兼容需要增加成本、付出代价

南北方差异较大:

✓多层建筑和大平层

✓有水地区无水地区

✓不同气候温度环境

风液同源:

✓屋顶外机冷源

✓ CDU + 双源空调末端

✓未来风液融合型精密空调或双水温冷机

PART 04 可预见的未来设计

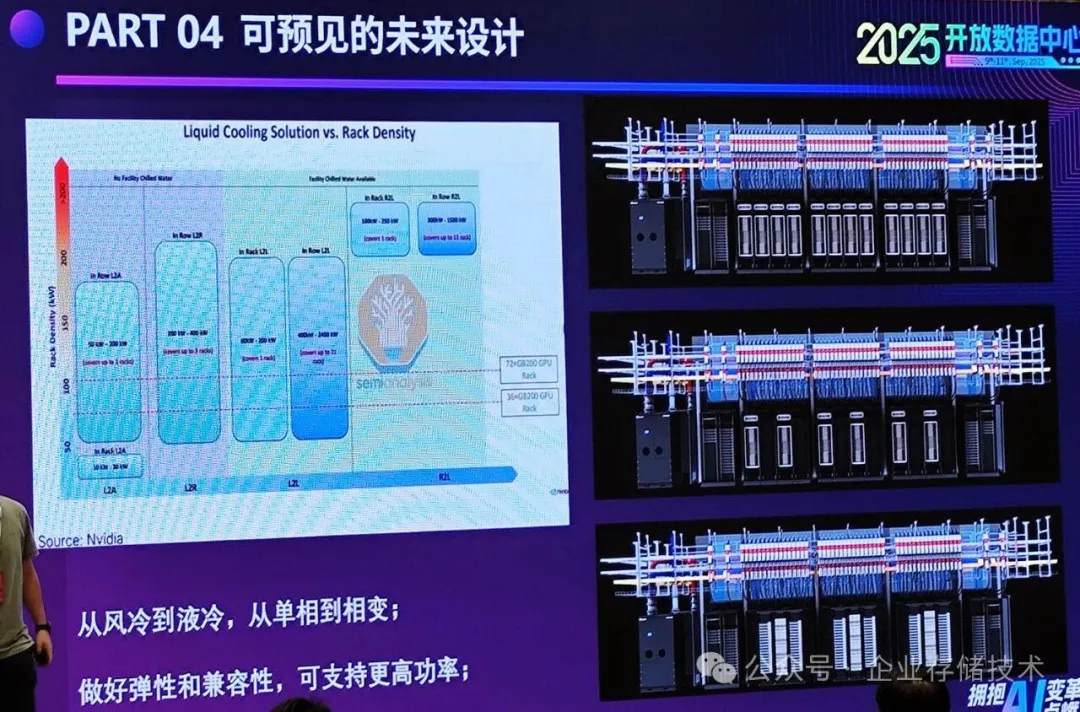

从风冷到液冷,从单相到相变;

做好弹性和兼容性,可支持更高功率

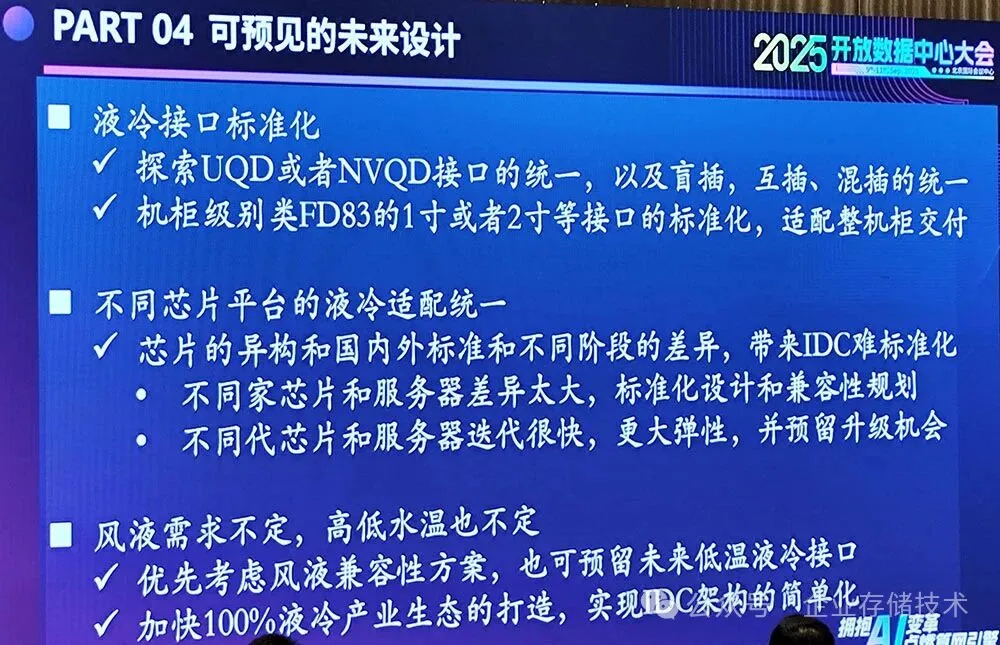

液冷接口标准化

✓探索 UQD 或者 NVQD 接口的统一,以及盲插,互插、混插的统一

✓机柜级别类 FD83 的 1 寸或者 2 寸等接口的标准化,适配整机柜交付

不同芯片平台的液冷适配统一

✓芯片的异构和国内外标准和不同阶段的差异,带来 IDC 难标准化

不同家芯片和服务器差异太大,标准化设计和兼容性规划

不同代芯片和服务器迭代很快,更大弹性,并预留升级机会

风液需求不定,高低水温也不定

✓优先考虑风液兼容性方案,也可预留未来低温液冷接口

✓加快 100% 液冷产业生态的打造,实现 IDC 架构的简单化

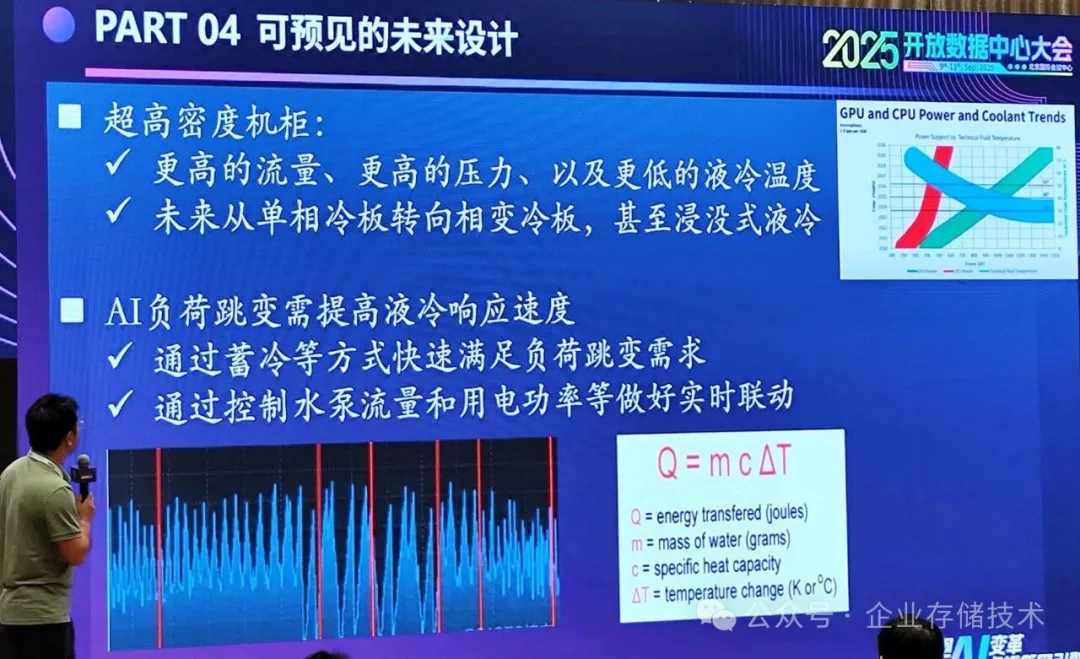

超高密度机柜:

✓更高的流量、更高的压力、以及更低的液冷温度

✓未来从单相冷板转向相变冷板,甚至浸没式液冷

AI 负荷跳变需提高液冷响应速度

✓通过蓄冷等方式快速满足负荷跳变需求

✓通过控制水泵流量和用电功率等做好实时联动

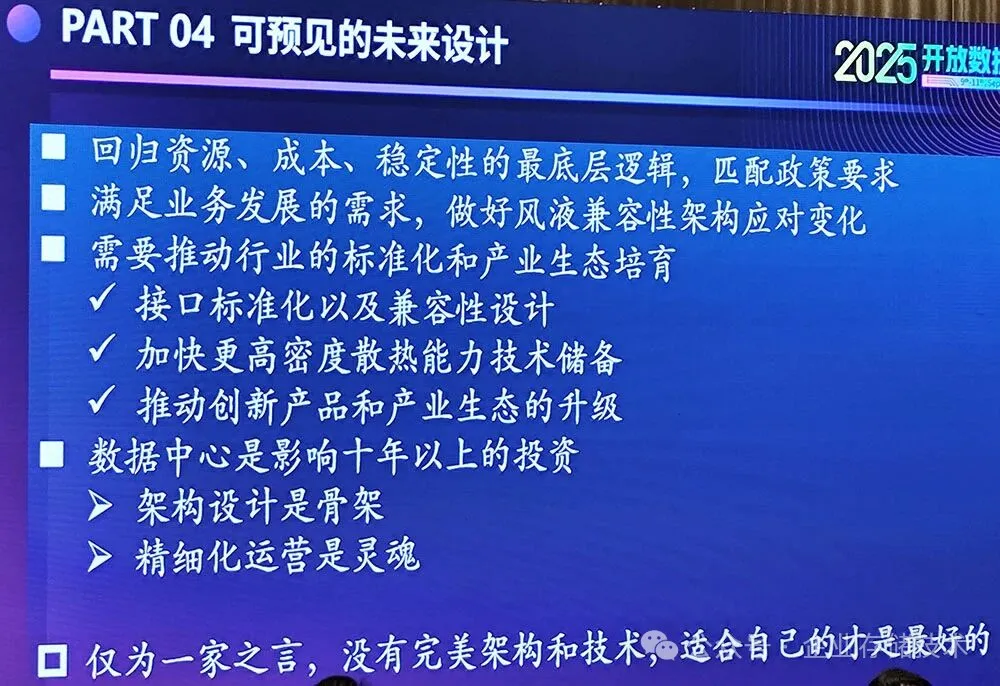

回归资源、成本、稳定性的最底层逻辑,匹配政策要求

满足业务发展的需求,做好风液兼容性架构应对变化

需要推动行业的标准化和产业生态培育

✓接口标准化以及兼容性设计

✓加快更高密度散热能力技术储备

✓推动创新产品和产业生态的升级

数据中心是影响十年以上的投资

➢架构设计是骨架

➢精细化运营是灵魂

仅为一家之言,没有完美架构和技术,适合自己的才是最好的。

本文仅作分享,不代表本人立场。如您认为平台推送文章侵犯了您的知识产权,请及时联系(411792714@qq.com),我们将第一时间删除。

加下面工作人员为好友时按照下面蓝字模式发送验证申请:

公司名称+姓名+数据中心。例如 华为 钱三强 数据中心 ,这样便于我们把您拉入到各个专业群。每周六统一入群

加下面工作人员为好友时按照上面蓝字模式发送验证申请